如何将DeepSeek部署到U盘上,或者部署到移动硬盘上?我在思考这么做的必要性,以及它是否有具体的应用场景。先不想后面了,我们先看是否可以部署到“移动端”,这里我们选择的是U盘,这种最常见的存储介质。

一、设备和环境准备

- 硬件设备 :一台 MAC MINI M1 电脑(有macOS的电脑即可)、一个 U 盘(建议容量不小于 32GB,以确保有足够的空间存储 DeepSeek 模型文件及相关数据)。

- 软件环境 :macOS 系统(确保是最新版本,以获得最佳的兼容性和性能)、Ollama(用于运行 DeepSeek 模型)。

- 说明:此教程主要针对的是macOS用户!

- 二、具体部署步骤

1.安装 Ollama

- 访问 Ollama 官方网站 :在浏览器中输入https://ollama.com/,进入 Ollama 的官网。

- 下载适用于 macOS 的安装包 :在官网找到下载区域,选择适用于 macOS 系统的安装包进行下载。

- 安装 Ollama :下载完成后,双击安装包文件,按照安装向导的提示进行安装。安装过程中可能需要输入电脑的管理员密码以授权安装操作。

- 验证安装 :安装完成后,打开终端(Terminal),输入

ollama -v,如果终端显示 Ollama 的版本号,则说明安装成功。

2.下载 DeepSeek 模型

- 选择模型版本 :根据你的电脑硬件配置,选择适合的 DeepSeek 模型版本。对于 MAC MINI M1 电脑,推荐选择 DeepSeek-R1-1.5B 版本。(这里我们用最小的模型,因为只验证可行性。)

- 下载模型 :在终端中输入以下命令下载 DeepSeek-R1-1.5B 模型:

ollama pull deepseek-r1:1.5b下载过程可能需要一些时间,具体取决于你的网络速度。

3.将模型文件和 Ollama 可执行文件移动到 U 盘

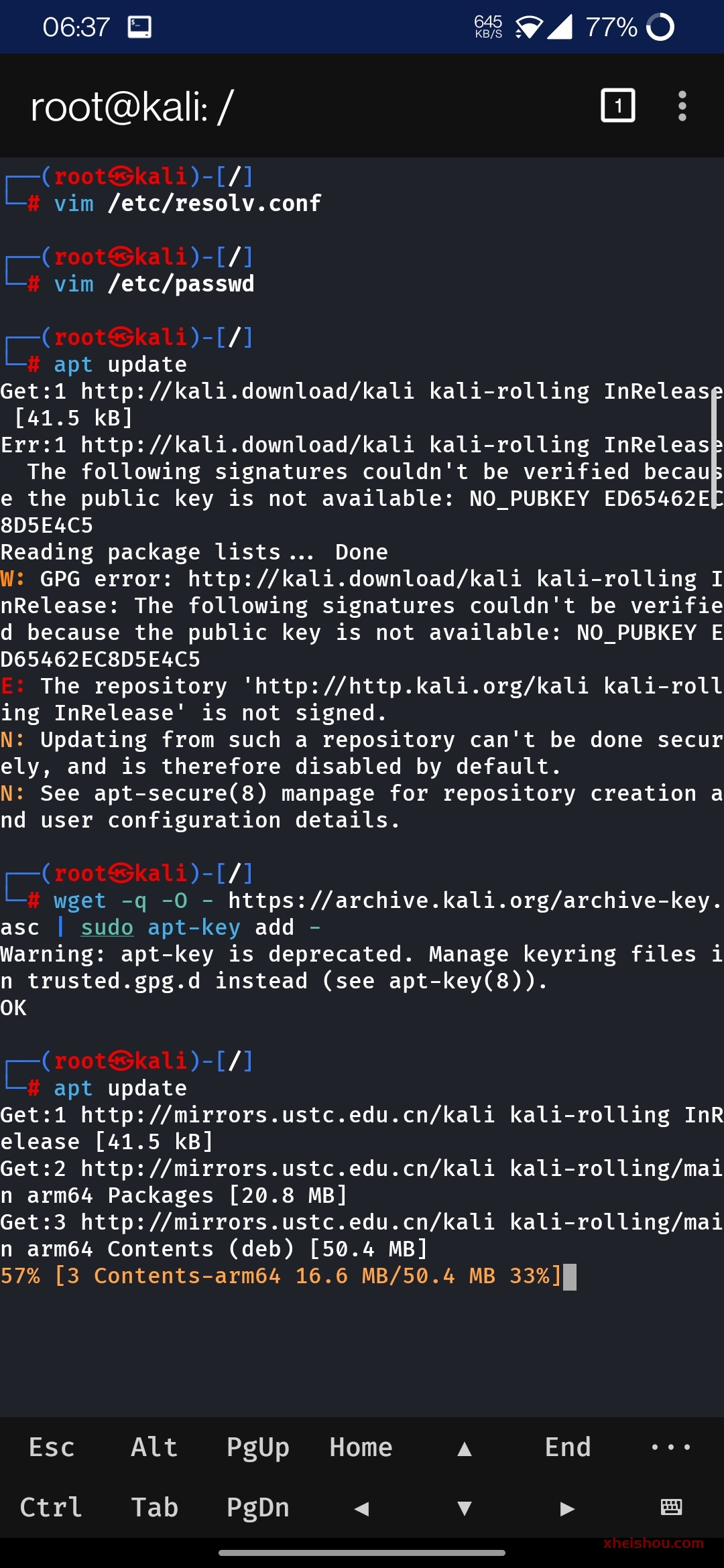

- 插入 U 盘 :将 U 盘插入 MAC MINI M1 电脑的 USB 接口。

- 挂载 U 盘 :在终端中输入以下命令,挂载 U 盘(设置U 盘的盘符为 “USB”):

sudo mount -o bind /Volumes/USB /mnt - 移动模型文件 :将下载好的 DeepSeek 模型文件从默认存储位置移动到 U 盘的指定目录下。模型文件通常存储在

~/.ollama/models目录下,你可以使用以下命令将模型文件移动到 U 盘:mv ~/.ollama/models/deepseek-r1:1.5b /mnt - 复制 Ollama 可执行文件 :将 Ollama 的可执行文件复制到 U 盘中。Ollama 的可执行文件通常位于

/usr/local/bin/ollama,你可以使用以下命令将其复制到 U 盘:sudo cp /usr/local/bin/ollama /mnt - 卸载 U 盘 :在终端中输入以下命令,卸载 U 盘:

sudo umount /mnt然后安全弹出 U 盘。

注意⚠️:文件路径及U盘中的文件结构很重要,否则会导致命令无法执行。如果搞不清楚目录和文件,也可以直接找到文件复制到U盘中,这个方法不推荐,但可以解决命令无法搞定的情况。deepseek模型文件的移动更容易出现类似情况。

解决方法如下(命令没问题的,不用看。直接看步骤4):

使用 ollama pull deepseek-r1:1.5b 命令下载 DeepSeek-R1-1.5B 模型时,模型文件会被存储在以下路径:/Users/evan/.ollama/models

默认存储路径: Ollama 会将下载的模型文件存储在用户主目录下的 .ollama 文件夹中。这个文件夹通常是一个隐藏文件夹,所以在 Finder 或终端中默认不可见。

具体路径:

1. 用户主目录是 /Users/evan(假设用户名为 evan)。

2. .ollama 是 Ollama 的存储目录。

3. models 文件夹存储了所有下载的模型文件blobs和manifests。

4. 把blobs和manifests直接复制到U盘(USB)中的mnt文件夹中即可。4.在其他 macOS 电脑上使用

- 插入 U 盘 :将制作好的 U 盘插入任何一台 macOS 系统的电脑的 USB 接口。

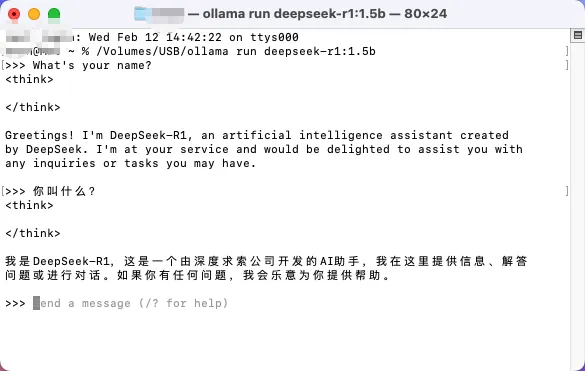

- 运行 DeepSeek :打开终端,输入以下命令运行 DeepSeek 模型:

/Volumes/USB/ollama run /Volumes/USB/deepseek-r1:1.5b模型运行后,打开浏览器,在地址栏输入http://localhost:11434,即可访问并使用 DeepSeek 模型。 - 如果运行有问题:

1. 设置环境变量 :在终端中输入以下命令,设置 Ollama 的模型路径环境变量:export OLLAMA_MODELS=/mnt

2. 运行模型 :在终端中输入以下命令运行 DeepSeek 模型:ollama run deepseek-r1:1.5b

完美运行

本文转载自 https://www.evan.xin/3302/

© 版权声明

1、本网站名称:

X黑手网

2、本站永久网址:https://www.xheishou.com

3、本网站的文章部分内容可能来源于网络,仅供大家学习与参考,如有侵权,请联系站长进行删除处理。

4、本站一切资源不代表本站立场,并不代表本站赞同其观点和对其真实性负责。

5、本站一律禁止以任何方式发布或转载任何违法的相关信息,访客发现请向站长举报

6、本站资源大多存储在云盘,如发现链接失效,请联系我们我们会第一时间更新。

2、本站永久网址:https://www.xheishou.com

3、本网站的文章部分内容可能来源于网络,仅供大家学习与参考,如有侵权,请联系站长进行删除处理。

4、本站一切资源不代表本站立场,并不代表本站赞同其观点和对其真实性负责。

5、本站一律禁止以任何方式发布或转载任何违法的相关信息,访客发现请向站长举报

6、本站资源大多存储在云盘,如发现链接失效,请联系我们我们会第一时间更新。

THE END

![图片[1]-MAC电脑 DeepSeek U 盘部署教程:从零开始的详细指南-X黑手网](https://www.evan.xin/wp-content/uploads/2025/02/deepseek-u.png)

暂无评论内容